El Allen Institute for AI ha liberado MolmoAct 2, una nueva versión de su modelo fundacional para robótica, junto con pesos, datasets y herramientas abiertas. La promesa es clara: que los robots razonen mejor sobre escenas 3D antes de actuar y que puedan ejecutar tareas físicas con menos dependencia de recetas cerradas o ajustes específicos para cada demostración.

La publicación importa por dos motivos. Primero, porque la robótica sigue necesitando modelos que funcionen con objetos, cámaras, brazos y errores del mundo real, no solo con benchmarks limpios. Segundo, porque Ai2 insiste en abrir una parte sustancial de la receta: pesos, datos, tokenizador de acciones y un dataset bimanual de más de 720 horas.

Razonar antes de mover el brazo

MolmoAct 2 parte de la idea de Action Reasoning Model: un sistema que interpreta el entorno en 3D antes de generar acciones para el robot. Según Ai2, la nueva versión usa Molmo 2-ER como columna vertebral de razonamiento espacial y añade un experto de acción que produce movimientos mediante flow matching.

La mejora más tangible está en la velocidad. Ai2 afirma que una llamada de acción tarda unos 180 ms en el modelo base y 790 ms con razonamiento adaptativo de profundidad, frente a los 6.700 ms del MolmoAct original en el entorno de benchmark LIBERO con una NVIDIA H100. La diferencia no es cosmética: un robot que pausa visiblemente entre movimientos parece torpe y pierde capacidad de recuperación; uno que responde casi en tiempo real puede entrar en tareas más útiles.

El modelo también incorpora MolmoAct 2-Think, que usa tokens de profundidad cuando la tarea necesita más razonamiento 3D. En vez de aplicar ese cálculo a toda la imagen siempre, el sistema intenta activarlo de forma adaptativa en las regiones donde puede aportar más, reduciendo latencia.

Datos abiertos para manipulación bimanual

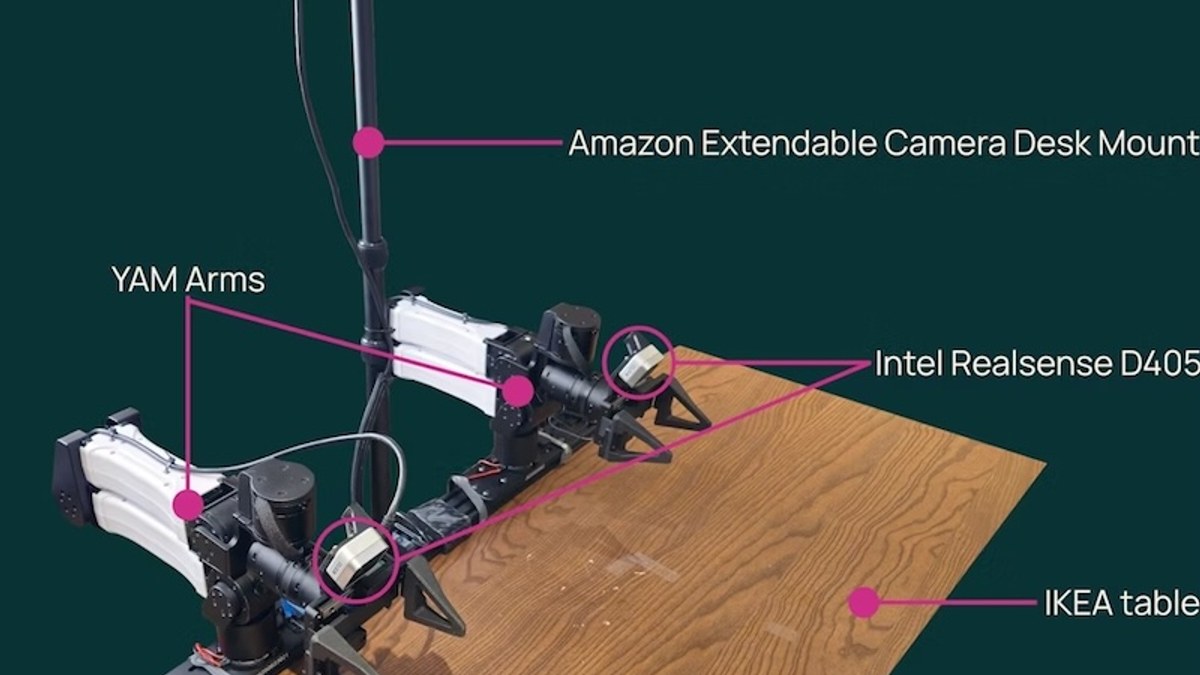

La otra pieza fuerte es el dataset MolmoAct 2-Bimanual YAM, con más de 720 horas de demostraciones de robots usando dos brazos. Incluye tareas como doblar toallas, escanear compras, cargar móviles, limpiar mesas o manipular objetos de laboratorio. Para un campo en el que muchos avances se publican con datos cerrados, esto tiene valor práctico: otros equipos pueden estudiar, reproducir y mejorar el sistema sin depender solo de vídeos o métricas resumidas.

Ai2 también combina esos datos con fuentes como Open X-Embodiment, DROID Franka, Bridge WidowX y datasets de brazos abiertos SO-100/SO-101. El objetivo es ampliar la variedad de brazos, cámaras, instrucciones y escenarios, aunque la propia organización reconoce una limitación importante: MolmoAct 2 funciona mejor en las plataformas para las que ha sido entrenado, y no se convierte mágicamente en un controlador universal para humanoides o manos robóticas nuevas.

En evaluaciones reales con un brazo Franka, Ai2 reporta tasas altas en tareas como colocar una manzana en un plato, poner una pipeta en una bandeja, insertar objetos en espacios estrechos o mover varios objetos a un bol. En una evaluación externa de Cortex AI, MolmoAct 2 habría quedado por delante de otros modelos robóticos en varias tareas bimanuales.

Del laboratorio húmedo a la robótica útil

Uno de los pilotos más interesantes está en Stanford School of Medicine. El Cong Lab prueba MolmoAct 2 en flujos de trabajo de CRISPR dentro de un proyecto de laboratorio autónomo, con tareas repetitivas como mover muestras entre estaciones u operar equipamiento de sobremesa. Es un buen caso de uso porque combina precisión, repetición y poca tolerancia a errores acumulados.

Ese enfoque es más convincente que vender el modelo como inteligencia general para cualquier robot. La robótica útil suele avanzar por dominios acotados: mesa, laboratorio, almacén, cocina, línea de producción. Si un modelo abierto reduce el coste de adaptar robots a tareas repetitivas dentro de esos entornos, puede tener más impacto que otra demo espectacular sin camino de despliegue.

Un avance abierto, pero no mágico

Ai2 es bastante explícita con las limitaciones. MolmoAct 2 planifica lotes de 10 a 30 movimientos y los ejecuta antes de volver a inferir, así que no reacciona de forma continua si ocurre algo inesperado en mitad de la secuencia. Además, usarlo fuera de las plataformas entrenadas requiere datos adicionales. Ese reconocimiento es sano: la robótica física no perdona los huecos entre benchmark y realidad.

La noticia, por tanto, no es que MolmoAct 2 resuelva la manipulación robótica. La noticia es que empuja una receta abierta para estudiarla de verdad: razonamiento espacial, dataset bimanual grande, tokenizador de acciones y resultados reproducibles. En un sector que se está llenando de modelos propietarios y vídeos cerrados, esa apertura puede ser justo lo que hace falta para que más laboratorios construyan sobre la misma base en vez de empezar desde cero.

Si la robótica fundacional quiere salir del laboratorio, necesitará algo más que modelos grandes: necesitará datos compartidos, evaluaciones honestas y sistemas que acepten sus límites. MolmoAct 2 no elimina esos problemas, pero pone una pieza útil encima de la mesa.