Durante años, la inteligencia artificial y la robótica avanzaron en paralelo, pero rara vez se encontraban de verdad. La primera evolucionaba en servidores y ordenadores, analizando texto, imágenes o datos. La segunda perfeccionaba máquinas físicas cada vez más precisas, aunque limitadas a ejecutar instrucciones predefinidas. En 2026, esa separación empieza a quedarse atrás.

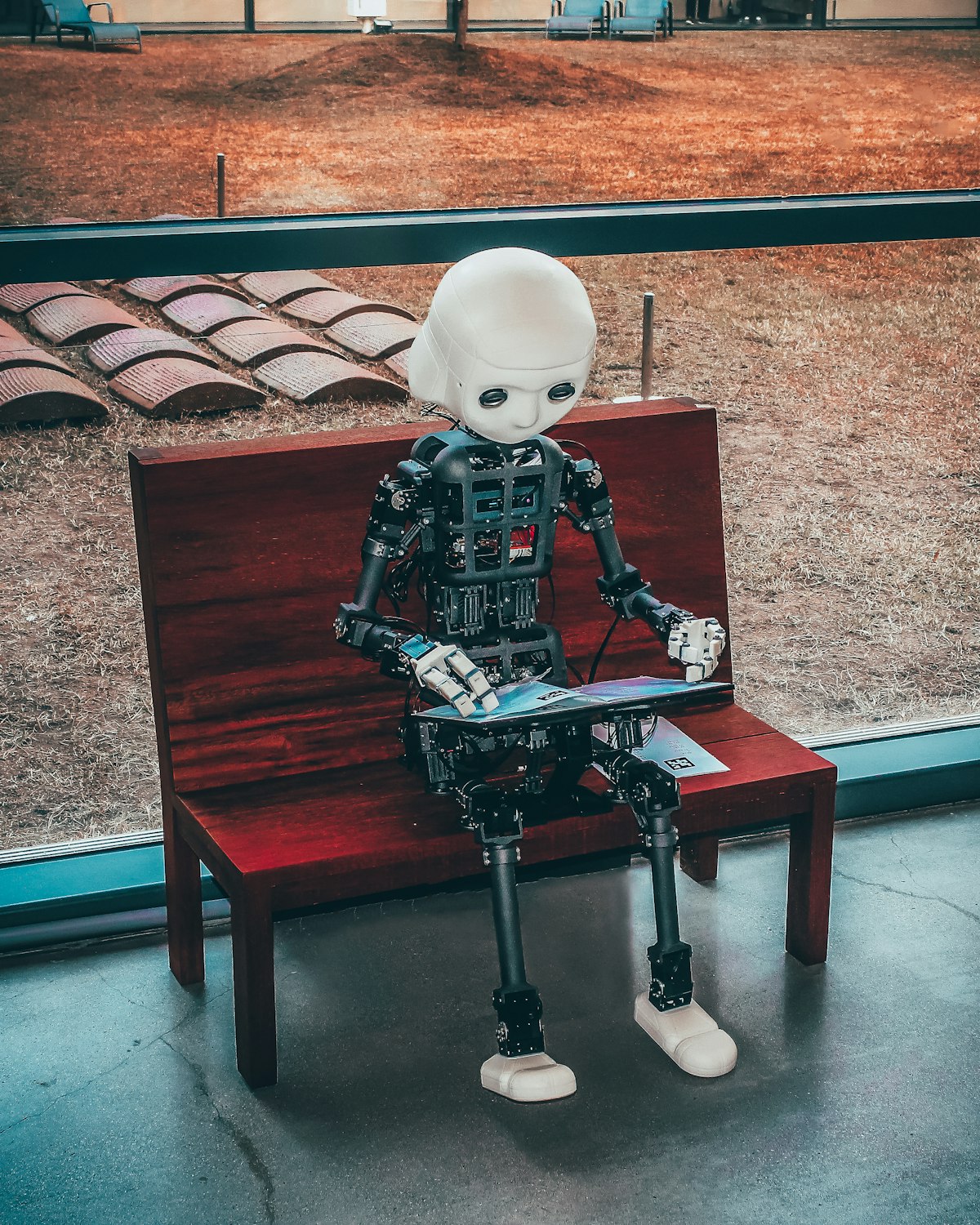

La combinación entre modelos de lenguaje, visión artificial y aprendizaje por refuerzo está dando lugar a una nueva generación de robots capaces no solo de moverse, sino también de interpretar órdenes, adaptarse al entorno y tomar decisiones operativas en tiempo real. La IA ya no vive solo en una pantalla: empieza a tener cuerpo.

La gran convergencia

La robótica llevaba tiempo esperando este momento. Para que la inteligencia artificial pueda integrarse de forma útil en una máquina física hacen falta tres condiciones, y las tres han madurado casi al mismo tiempo.

La primera es disponer de modelos de IA suficientemente avanzados para comprender lenguaje natural, razonar sobre situaciones físicas y planificar secuencias de acciones. Ya no se trata solo de reconocer objetos o clasificar imágenes, sino de traducir una instrucción en pasos ejecutables dentro de un entorno real.

La segunda condición es el hardware. En los últimos años, actuadores eléctricos más eficientes, sensores de fuerza más precisos y baterías con mejor densidad energética han permitido construir robots más ágiles, más seguros y también más asequibles.

La tercera son los datos. Durante mucho tiempo, este fue el cuello de botella más serio. Hoy, la expansión de los entornos de simulación fotorrealista, como Isaac Sim de Nvidia, y el crecimiento de los datos de teleoperación humana han acelerado el entrenamiento de sistemas capaces de aprender tareas complejas sin depender únicamente de pruebas físicas lentas y costosas.

Los modelos de IA que están transformando la robótica

Modelos de mundo

Los llamados world models permiten al robot construir una representación interna del entorno y anticipar qué puede ocurrir si ejecuta una acción concreta. En la práctica, eso significa que la máquina no actúa solo por reflejo o por programación rígida: puede estimar consecuencias antes de moverse.

Un robot con este tipo de modelo puede evaluar si un vaso se volcará al agarrarlo desde cierto ángulo, o si una trayectoria concreta puede chocar con otro objeto presente en la escena.

Aprendizaje por refuerzo a gran escala

El aprendizaje por refuerzo ha ganado peso en robótica gracias a la capacidad de entrenar millones de intentos en simulación. Eso permite que un sistema aprenda por ensayo y error sin poner en riesgo hardware real ni ralentizar el desarrollo.

El gran reto está en transferir lo aprendido al mundo físico. Aun así, el avance en técnicas de sim-to-real transfer ya permite llevar a robots reales parte de lo entrenado en entornos virtuales, con resultados cada vez más sólidos.

IA generativa como interfaz de control

Uno de los cambios más visibles es la aparición de modelos generativos como capa de interacción. En lugar de programar cada secuencia a bajo nivel, el operario puede indicar una tarea en lenguaje natural y dejar que el sistema la traduzca en subtareas, comprobaciones y acciones.

Eso no significa que el robot entienda el mundo como una persona, pero sí que la interfaz de control se vuelve mucho más accesible. La barrera entre el conocimiento técnico y la operación cotidiana empieza a reducirse.

El problema del sim-to-real gap

A pesar de los avances, uno de los mayores obstáculos sigue siendo la distancia entre la simulación y el mundo real. Un modelo puede funcionar de forma impecable en un entorno virtual y fallar en cuanto cambia la iluminación, aparece un reflejo inesperado o el objeto tiene una textura distinta de la prevista.

Ese desfase —conocido como sim-to-real gap— es uno de los problemas más complejos de la robótica actual. Para reducirlo, los investigadores combinan simulaciones físicamente más realistas con técnicas de domain randomization, que exponen al sistema a miles de variaciones del entorno durante el entrenamiento para mejorar su capacidad de generalizar.

La dimensión ética: robots con IA en el mundo real

La integración de IA avanzada en robots físicos no es solo un reto técnico. También plantea preguntas que la regulación actual todavía no ha resuelto.

Responsabilidad y toma de decisiones autónoma

Cuando un robot actúa de forma autónoma y causa un daño, aunque sea accidental, la pregunta sobre quién responde no tiene respuesta sencilla. ¿El fabricante del hardware? ¿El proveedor del modelo de IA? ¿La empresa que lo desplegó? Los marcos legales vigentes no contemplan bien este tipo de situaciones, y los reguladores europeos trabajan para cerrar esa brecha.

Privacidad y vigilancia

Un robot con cámaras y capacidad de reconocimiento visual en un entorno doméstico o semipúblico es, de facto, un dispositivo con alto potencial de vigilancia. El AI Act europeo aborda parte de esta problemática, pero la regulación específica para robots autónomos en espacios privados sigue siendo incompleta.

Autonomía y control humano

La mayoría de las empresas e investigadores del sector defienden hoy modelos de funcionamiento donde el robot opera de forma autónoma en tareas rutinarias, pero requiere validación humana cuando las consecuencias de una decisión son relevantes. El debate sobre dónde situar ese umbral no está cerrado, y probablemente cambiará a medida que la tecnología avance.

El horizonte: robots que aprenden de la experiencia colectiva

Uno de los escenarios más prometedores que se barajan en la intersección entre IA y robótica es el del aprendizaje colectivo. En lugar de que cada robot aprenda por su cuenta, una flota entera puede compartir experiencias y mejorar el modelo común de forma continua.

Si un robot aprende a abrir un tipo de puerta que nunca había visto, ese conocimiento puede estar disponible para el resto de la flota en pocas horas. Es una forma de acelerar el aprendizaje que no tiene equivalente en la biología, y que podría reducir de forma drástica el tiempo necesario para que un sistema robótico se vuelva competente en un nuevo entorno.

Estamos ante una de las transformaciones tecnológicas más profundas de las últimas décadas. La IA que durante años vivió confinada en pantallas y servidores está tomando forma física. Con eso llegan nuevas capacidades, nuevas oportunidades y también nuevas responsabilidades. El debate acaba de empezar.